فايل Robots.txt چيست؟ و چه تأثیری بر روی سئو دارد؟

با فايل Robots.txt میتوانيد دسترسی رباتهای گوگل و ساير موتورهای جستجو را بر روی وبسایتتان مديريت كنيد. در واقع با كمك فايل ربات تی ايكس تی میتوانيد به رباتهای گوگل دستورات دلخواه خود را بدهيد.

در اين مقاله هر آنچه كه نياز داريد راجع به فايل Robots.txt بدانيد را خدمت شما عزيزان آموزش میدهيم.

همچنین شما عزیزان اگر میخواهید راجع به سایر مطالب تخصصی ما در زمینه طراحی سایت، سئو، طراحی اپلیکیشن، دیجیتال مارکتینگ و غیره بیشتر بدانید، به صفحه مقالات وب فهم مراجعه کنید.

مقدمه

- با يك مثال فايل Robots.txt را خدمت شما عزيزان معرفي میكنيم.

- فرض كنيد شما برای انجام امور اداری وارد يك سازمان يا اداره بزرگی شديد. در اين مكان قسمت درب ورودی يك باجه را قرار دادند بهعنوان باجه اطلاعات و فردی يا افرادی هستند كه بهعنوان افراد راهنما در اين باجه اطلاعات پاسخگو هستند. اگر موقعی اين افراد در باجه نباشند كل اداره به هرجومرج میفتد و همه افراد برای پیداکردن اتاق موردنظر خود كل سازمان را چند بار بالا و پايين میكنند و حتی اين موضوع باعث میشود كه خود كارمندان نيز نتوانند كار و فعاليت خود را انجام دهند.

- فايل ربات تی ايكس تی نيز در وب سايت شما حكم نگهبان يا مسئول باجه اطلاعات وب سايت شما را دارد. تفاوت آن با مسئول اطلاعات اين سازمان اين است كه مسئول اطلاعات جهت راهنمای تمامی افرادی كه تازهوارد شدند هستند؛ اما فايل ربات تی ايكس تی نقش راهنما برای رباتهایی كه وارد وب سايت شدند و میخواهند وب سايت شما را بررسی كنند را دارند.

- وب سايت شما به جز بازدیدکننده و كاربر روزانه رباتهای ورودی دارد كه میخواهند وارد سايت شما شوند و سایت شما را بررسی کنند.

ربات چیست؟

- رباتها نرمافزارهایی هستند که بهصورت خودکار صفحههای مختلف وب سایت را باز و بسته میکنند.

- رباتهای موتورهای جستجوی گوگل مهمترین رباتهایی هستند که هر روز چندین بار وب سایت ها را بررسی میکنند. یک وب سایت ممکن است روزانه چند هزار بار مورد بررسی گوگل قرار گیرد.

- هر ربات کاربرد خود را در وب سایت شما دارد و برای بررسی سایت شما توسط الگوریتمهای گوگل ضروری است.

رباتهای موتورهای جستجو چیست؟ | ربات چیست؟

آیا میتوانیم جلوی ورود رباتها را بگیریم؟

بله میتوانید دسترسی رباتها را به صفحات گوگل محدود کنید. رباتها صفر تا صد سایت شما را بررسی میکنند. حتی گاهی اوقات رباتها چیزهایی که شما نمیخواهید دیده شود را در سایت شما میبینند و بررسی میکنند و در سرور گوگل ذخیره میکنند. قطعاً باید راهی باشد که جلوی ورود رباتها را به برخی قسمتهای سایت بگیریم.

شما میتوانید با نوشتن دستوراتی در فايل Robots.txt جلوی ورود ربات را به برخی قسمتهای سایتتان بگیرید.

در ادامه این مطلب باهم بررسی میکنیم که فایل Robots.txt چیست؟ و چه وظیفهای دارد؟ چگونه میتوانیم از فایل Robots.txt استفاده کنیم؟

فايل Robots.txt چیست؟

در واقع فایل ربات تی ایکس تی یک فایل متنی ساده است که میتوانید روی سرور خود قرار دهید. این قوانینی است که برای خزندهها تعیین میکند کدام صفحات خزیده شوند و کدام صفحات خزیده نشوند.

فایل ربات تی ایکس تی فایل مجوز دهنده به رباتها است. وقتی که رباتها وارد سایت شما میشوند و صفحههای سایت شما را بررسی کنند، اول فایل Robots.txt را فراخوانی میکنند. در این فایل با تعیین نمودن چند دستور ساده میتوان مشخص کرد که رباتها اجازه دسترسی به کدام صفحات سایت را دارند.

فایل Robots.txt چیست؟ | چه ضرورتی دارد؟

فايل Robots.txt چگونه کار میکند؟

خزندهها برنامههایی هستند که در صفحات وب سایت شما میخزند. خزندهها دارای کاربرد بسیاری هستند؛ اما موتورهای جست و جو مثل گوگل از اینها برای پیداکردن محتوای وب برای ایندکس کردن استفاده میکنند. این فرایند طبق مراحل زیر صورت میگیرد:

خزندهها دارای یک لیستی از URLهایی هستند که دارای وب سایت های جدید و قدیمی است که میخواهند در آن صفحات بخزند.

خزندهها قبل از خزیدن به دنبال فایل robots.txt در دایرکتوری وب سایت میگردند.

اگر هیچ فایل ربات تی ایکس تی وجود نداشته باشد، خزندهها بهصورت آزادانه و بدون هیچ دستور العملی وارد وب سایت ها میشوند و به خزیدن ادامه میدهند اما اگر فایل ربات تی ایکس تی ایکس تی وجود داشته باشد، خزنده ها با کمک دستورالعمل ها به خزیدن وب سایت ها میپردازند.

اگر خزندهای نتواند صفحه را بخزد آن صفحه نیز ایندکس نمیشود و در صفحات جست و جو نیز رتبه نمیگیرد.

همچنین به نکات زیر توجه کنید که:

- ممکن است که صفحهای از خزیدن مسدود شده باشد؛ اما همچنان ایندکس شود.

مسدودکردن خزیدن در فايل Robots.txt تضمین نمیکند که موتورهای جستوجو صفحه را ایندکس نکند. اگر آن صفحه محتوای مهمی داشته باشد و اطلاعات آن صفحه را در منابع دیگر بیابند ممکن است در صفحه شما بخزند.

- شما نمیتوانید خزنده ها را مجبور کنید که حتماً از قوانین فايل Robots.txt پیروی کنند.

به این موضوع دقت کنید که فایل Robots.txt یک دستورالعمل است یک قانون اجباری نیست و شما نیز نمیتوانید رباتها را مجبور کنید که حتماً از آنها پیروی کنند.

ضرورت داشتن فايل Robots.txt چیست؟

طراحان سایت و کارشناسان سئو و وبمستر میتوانند با داشتن فايل Robots.txt ورود رباتها را به وب سایت شما کنترل کنند.

همه صفحات وب سایت به یک اندازه ارزشمند نیستند و برای مثال کارشناسان سئو و وبمستر نمیخواهند پنل مدیریت سایت در موتورهای جستوجو ایندکس شود و در اختیار همه کاربران و عموم قرار گیرد. برای جلوگیری از این موضوع با کمک فایل ربات تی ایکس تی دستوری را تعریف میکنند تا دسترسی رباتها را به صفحات وب سایت محدود کنند.

آیا با داشتن فايل Robots.txt میتوان صفحهای را از نتایج جستجو حذف کرد؟

حتماً شما هم تا الان اگر میخواستید صفحهای را از دید گوگل خارج کنید با دستور noindex این کار را انجام میدهید.

گوگل اعلام کرده است که برای حذف صفحهها از نتایج جستوجو بهتر است از راههای دیگری هم به جز فایل Robots.txt استفاده کنید.

چرا به فايل Robots.txt نیاز داریم؟

وجود فایل Robots.txt در وب سایت شما بسیار مهم است و میتواند از بسیاری از جهات برای وب سایت شما مهم باشد و به شما در خزش خزندهها کمک کند و این فرایند را بهینه کند.

رباتهای موتورهای جستوجو تعداد URLهایی که میتوانند در یک وب سایت مشخص بخزند را محدود میکنند. اگر به این موضوع کمتر اهمیت دهید ممکن است که خزش به صفحات باارزش انجام نشود و صفحات مهم شما یا ایندکس نشود یا دیرتر ایندکس شود و بهمرور متوجه میشوید که چقدر وجود فایل ربات تی ایکس تی میتواند برای وب سایت شما ضرورت داشته باشد.

همچنین با فايل Robots.txt میتوانید از خزیدن به برخی صفحات باکیفیت پایین و بیارزش جلوگیری کنید. اگر تعداد بسیار زیادی صفحات بیارزش شما ایندکس شود بر کل وب سایت شما تأثیر نامطلوبی دارد.

چه صفحاتی نباید ایندکس شوند؟

با کمک فايل Robots.txt میتوانید از ایندکسشدن برخی از صفحات جلوگیری کنید که این صفحات شامل موارد زیر است:

- duplicate content: صفحاتی که دارای محتوای تکراری هستند.

- برچسبهایی که باعث ایجاد محتوای تکراری در سایت میشود.

- صفحات فیلتربندی محصول بر اساس رنگ و قیمت و غیره

- برخی از فایلهای قالب سایت که نیازی نیست توسط گوگل دیده شود.

- صفحات چت در سایت

- صفحات پروفایل کاربران سایت

- تمامی صفحات پنل پیشخوان سایت که فقط ادمین و مدیران سایت دسترسی دارند.

فايل Robots.txt را چگونه تغییر دهیم؟

نحوه تغییر فايل Robots.txt به نوع سیستمی که از آن استفاده میکنید بستگی دارد. اگر از یک پلتفرم تجارت الکترونیک استفاده میکنید ممکن است که به ابزارها یا افزونههای اختصاصی دسترسی داشته باشید که به شما کمک کند تا به فایل دسترسی داشته باشید و بتوانید آن را تغییر دهید.

برای مثال اگر از سیستم مدیریت محتوای وردپرس استفاده میکنید میتوانید از افزونه Yoast SEO استفاده کنید.

اگر هم از پلتفرم تجارت الکترونیک استفاده نمیکنید لازم است که فایل را دانلود کرده و آن را ویرایش کنید و سپس آن را در وب سایت خود آپلود کنید.

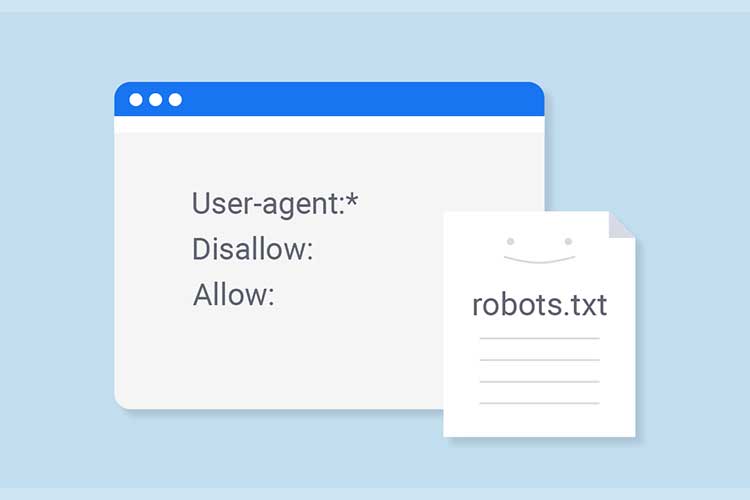

دستورالعملهای فايل Robots.txt

دستورالعملها قوانینی هستند که شما برای رباتهای موتور جستجو تعریف میکنید. این دستورالعملها شامل موارد زیر هستند:

Disallow

Allow

Sitemap

Crawl-delay

نکته: اگر نمیخواهید برخی از صفحات وب سایتتان ایندکس شود، از تگ متا رباتهای noindex یا هدر X-Robots-Tag استفاده کنید.

دستورالعمل های فایل Robots.txt

Disallow

با کمک این دستورالعمل میتوانید مشخص کنید که کدام صفحات نباید خزیده شوند. اگر صفحهای توسط دستورالعمل Disallow مسدود نشده باشد، به طور پیشفرض رباتهای موتورهای جستوجو میتوانند بخزند.

برای مسدودکردن با دستورالعمل Disallow نیز مطابق زیر انجام دهید:

User-agent: Googlebot

Disallow: /users /

دستورالعمل Allow

شما میتوانید با کمک دستورالعمل Allow به خزیدن به یک صفحه در فهرست غیرمجازها کمک کنید.

User-agent: Googlebot

Disallow: /users/

Allow: /users/very-important-user.html

نقشه سایت: Sitemap

دستورالعمل نقشه سایت، مکان سایت مپ شما را مشخص میکند. این دستورالعمل را بهشدت برای بهینهسازی سایتتان توصیه میکنیم.

نتیجهگیری از فايل Robots.txt

اگر فايل Robots.txt برای وب سایت خود ایجاد کنید و بهدرستی آن را راهاندازی کنید، فرایند ایندکس کردن سایتتان بهخوبی انجام میشود. هر چه رباتهای موتورهای جست و جو بهتر بتوانند به صفحات باارزش شما خزش کنند، صفحات باارزش شما نیز زودتر ایندکس میشود.

از همراهی شما عزیزان سپاسگزاریم.

خدمات وب فهم

شرکت دانشبنیان فن آوران هوش مکانی با بهرهگیری از دانش بروز و تجربه چندین ساله خود در زمینههای طراحی سایت و توسعه آن، طراحی اپلیکیشن موبایل، طراحی وب اپلیکیشن، بهینهسازی سایت و خدمات سئو، دیجیتال مارکتینگ و تولید محتوا، فعالیت خود را در سال ۱۳۹۷ باهدف ارائه بهترین خدمات آغاز کرد.

این مجموعه تجربه همکاری با بیش از ۷۰ ارگان، شرکت و برندهای موفق را داشته و توانسته رضایت آنان را جلب کند. وب فهم آمادگی همکاری مداوم و هدفمند را در زمینه تخصصی شما اعلام مینماید.

ویژگیهای وب فهم

یکی از ویژگیهای منحصربهفرد وب فهم پشتیبانی سریع و حرفهای کارشناسان وب فهم به مدتزمان ۶ – ۸ و ۱۲ماهه بهصورت رایگان است. درصورتیکه پس از طراحی سایت شما هرگونه پشتیبانی نیاز داشتید، با کارشناسان ما تماس بگیرید.

هدف ما ارائه خدمات حرفهای با جهت جلب رضایت شما کارفرمایان عزیز است. مشاوره طراحی سایت کارشناسان وب فهم بهصورت جلسات حضوری، تلفنی و آنلاین است. دوره پشتیبانی به مدتزمان ۶ – ۱۲ ماه است و بنا به انتخاب پلن طراحی سایت شما متغیر است. اگر برای انتخاب پلن طراحی سایت خود نیز تردید دارید میتوانید با پشتیبانان ما مشورت کنید.